EP 87

「カチッ」の時代、悲しみと喜びのあいだ

イントロ: AIカチッ時代の不安感 0:00

ロ・ジョンソク 収録している今日は2026年2月21日土曜日の朝です。先週、シン・ジョンギュ代表のセッションをやりましたが、本当に進化のスピードがさらに速くなっている感じですよね。あちこちでカチカチカチッと、1日で作った、1週間で作った、こういった質の高いソフトウェアがどんどん出てきていて私たちも目が回る状況なんですが。それと同時に出てきている意見が、もうイライラする、憂鬱だ、これどうすればいいんだというそういった声がけっこうあるんですよね。私はイライラとか憂鬱という表現を直接的にはあまり使わないんですが、

チェ・スンジュン 内心そう感じている部分はあると思います。OpenClawの頃からだと思います。エージェントswarm、エージェントチームが出てきてからはいろいろ回して試すトレンドに自分がうまくついていけていないなという感覚を受けまして、なので私はこの1月、2月を急いで進むよりはゆっくり考える感じで進んでいるんですが、そうしているうちに、ゆっくり考えていると背景はどんどん先に進んでいくのでFOMOに陥る悪循環があるような気がします。なので最近あったことも振り返りつつ、それをまだ正解は持っていないんですが、自分なりのやり方でどう向き合っているかを少しお話ししてみようと思うんですが。

MVK、知らないままでも正しい方向へ 1:15

チェ・スンジュン 私が2月初めにUneven Futureで発表した時の最後のスライドが「分からないままでも正しい方向に進むには最低限何を知っておくべきか」というもので、そのMVK、Minimum Viable Knowledge、このチャンネルでも何度かお話ししましたが、それをテーマに話をしながら締めくくったんですが、ずっとこれが頭の中にあるテーマなんですよ。なのでこれをどうやって知っていけるかという悩みを抱えているんですが、今日の話もそれに関連する流れになると思います。その前に、これは今日未明に出たニュースなんですが。

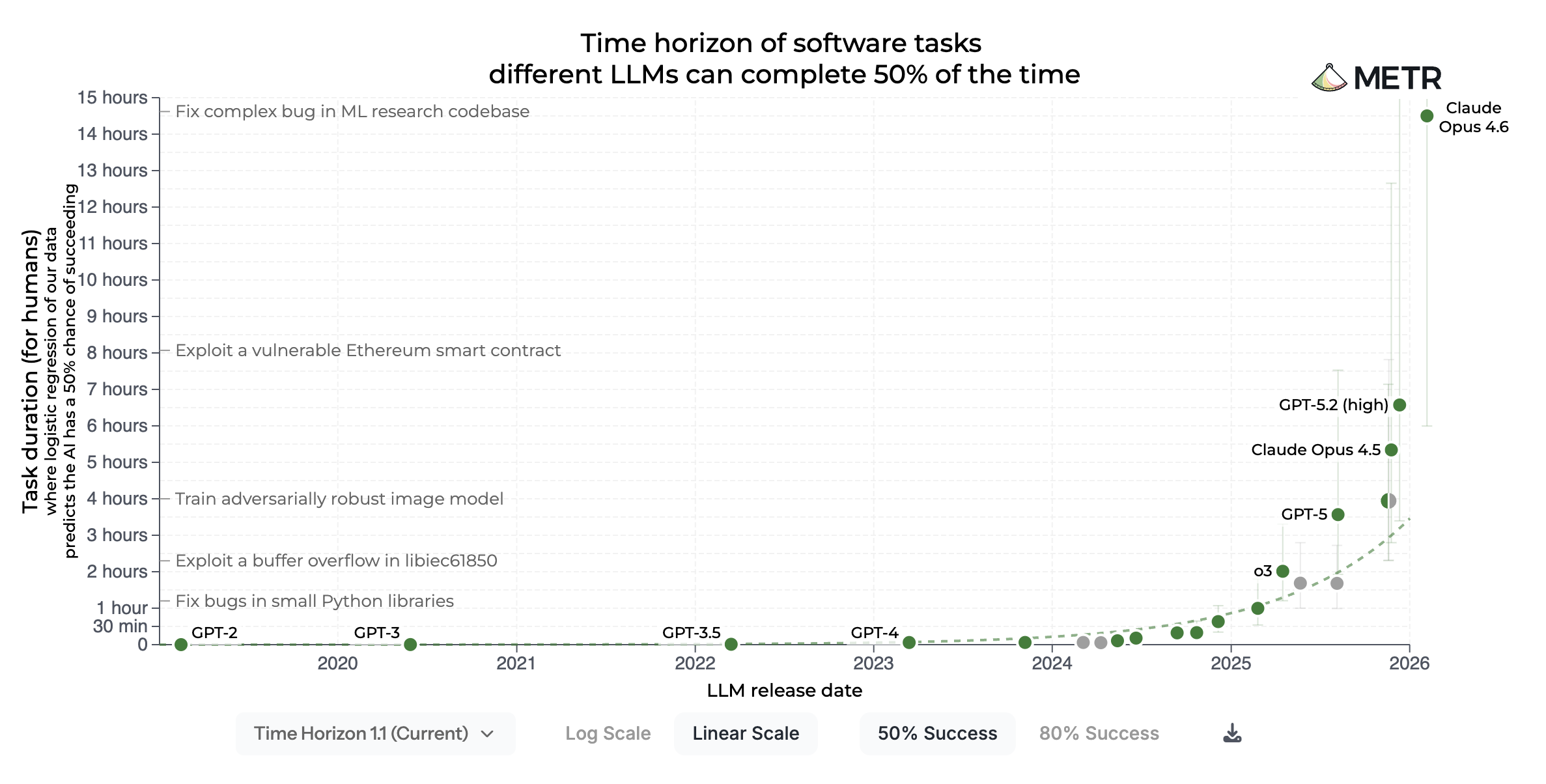

METRベンチマーク飽和: Claude Opus 4.6の14時間 1:47

チェ・スンジュン METRがClaude Opus 4.6を測定した結果を発表しました。なんと14時間が出てしまったんですよ。私たちがずっと収録しながら来年の5月、7月頃には人間のフルデイ8時間に達するんじゃないかと、そういう話をしていたじゃないですか。それがGPT-5.2がほぼ5時間に達したと思ったら、4.6がこれ、今ログスケールのグラフなのであまり差がないように見えて予想範囲内だなと感じるんですが、リニアで見ると今これだけ伸びているんですよ。

ロ・ジョンソク ドンと跳ね上がりましたね。それでMETRも言っているんですが

チェ・スンジュン 自分たちのタスクがsaturateしたようだと。別のものを準備中だと、それでこのグラフが今、意味を失う瞬間に来たようです。

ロ・ジョンソク これは実はグラフの目的自体が、AIが人の介入なしにどれだけ一人で長く働けるかということだったんですが、私たちは1日8時間働くじゃないですか。つまりその8時間も集中して働いているわけでもなくだいたい3〜4時間働くとした場合、これは14時間ずっと仕事だけしますからね。

チェ・スンジュン そうですよね。これには50%バージョンと80%バージョンがあって、単に長くやるだけではなく人間が働く時間に対応する形で測定しているんですが、いずれにしても人間が16時間かかる仕事の50%の成功率でAIが遂行しているというのが現在の解釈ですが、saturateしたというニュースから始まりました。今日の未明に。そして0.1ずつ上げていくのがトレンドになっているようです。Sonnet 5が出ると言われていましたが、4.6が出ました。先週出たばかりで、まだちゃんと試せていません。Claude Opus 4.6を使う慣性があってOpusをずっと回しているんですが、でも4.6もたぶん優秀でしょうね。さらに安くなりそうですし。それからGemini 3.1 Proが発表されましたよね。

Gemini 3.1 Proと終わりなく出る新モデル 3:40

チェ・スンジュン ベンチマークはまだ天井がかなり高そうですね。まだ良くなる余地があるという感じで実際にどんどん良くなっていますからこれからもさらに良くなっていく予定のようです。今このくらいがGemini 3.1 Proの水準だとJeff Deanが投稿していますね。今Google AI Studioで試せるようになっているんですが、昨晩回したものが10時間回った挙句生成されませんでした。何が出るかワクワクしていたんですが、収録直前に何かエラーがあると言われまして。なのでまだちゃんと性能テストはできていないんですが。ただモデルはどんどん出てきているということですよね。そしてこれからも出る予定です。どう評価すべきでしょうか?もう何というか、ちょっと感覚が麻痺してきた感じもありますし。モデルって実は汎用性の究極ですよね。

ロ・ジョンソク 何でもできるという能力なんですが、その最も汎用的なものが最も専門的だということを、先日Claude Codeを作ったBoris ChernyがY CombinatorのYouTubeに出て話していたんですよ。その強力な汎用知能によって他のドメインでも圧倒的な成果を出しているじゃないですか。最近その影響を大きく受けているのが科学分野のようですし、たぶんその話をしてくださると思うんですが、できないことがないんですよ。見ているだけでも少ししんどいです。もちろん日常生活で使っていると

チェ・スンジュン うまくいかない部分もあるにはありますが、方向性自体はできなかったことができるようになっていく方向なのは確かですよね。それから2月18日、数日前なんですが。Chris Lattnerという方がいて、LLVMを作ってSwiftも作って、Appleにいてからテスラに行って今はModularという会社を立ち上げましたよね。もともとコンパイラをやっていた方なのでコンパイラには詳しいですよね。それでClaude CodeのCコンパイラが出た時に、その日の投稿で「今まで見てきた中でコンパイラ関連のドキュメンテーションとしては最高峰だと思う」、ドキュメンテーションがよくできているという印象を残してもう少し詳しく見てみると言っていたんですが、その内容をブログに詳しく書いたものを翻訳してみました。前半部分では、教科書的な価値があるほどの実装だと思うという話をしています。褒めている部分がけっこうあって、その後、もちろん少し惜しい部分なども挙げていますが。しっかりとした方向性を持っていて、これはslopではなく、見る価値のあるものだと。それからcommit履歴があるのでそれを辿っていく内容にかなり意味のある部分がある、といった話をしています。

Chris LattnerのClaude Cコンパイラ深掘りレビュー 5:11

チェ・スンジュン ただ、何が問題だったのかという部分を指摘してくれたことがあって、ClaudeのCコンパイラで最も目立つ部分はミスなんですが、それは最後の部分、テストに必要なものをハードコーディングしていたのが最大の問題で、これはテストスイートを超えて一般化しにくいというシグナルであり、これは驚きというよりは有益な情報だと。現在のAIシステムは既知の手法を組み合わせ、測定可能な成功基準に合わせて最適化するのには優れているが、プロダクションレベルのシステムに必要なオープンエンドの一般化には困難を抱えているということを示していると。

しかし、この観察がより深い問いにつながるなら、AIコーディング自体について何を語っているのか、という部分も興味深く語られていました。私はこの部分を重要だと思いましたが、限界の部分を。既知の抽象化を実装することと新しい抽象化を発明することは違います。繰り返しの雑務を取り除き、最新のベストプラクティスからより近い出発点で始められるようにするマイルストーンの役割は果たしていますが、限界も露呈していて、新しい抽象化を発明するには至っておらず、この実装に新しいものは何も見当たらないと。しかし、教科書的な実装であることは確かだと。結びの言葉でこんな話をしていました。

ソフトウェアの終焉やエンジニアの終焉を語っているのではないと。そういうのは少しhypeであって、むしろ扉をもっと大きく開くことに近いのだと。なぜなら、実装が容易になるほど本当のイノベーションが入り込む余地はさらに広がるということです。だから実装の障壁が下がったからといってエンジニアの重要性が減るわけではなく、むしろビジョン、判断力、センスの重要性がさらに増すと。作ることが容易になるほど、何が作る価値のあるものかを決めることがより難しい問題になると。AIは実行を加速させるが、意味と方向性、責任は根本的に人間の領分として残ると。だからこの話も意味深いですね。コードを書くことが目標だったことはない。目標は意味のあるソフトウェアを作ることだ。未来は新しいツールを受け入れ、前提を疑い、人々が共に作れるように助けるシステムを設計するチームのものだと。

ロ・ジョンソク 先週、シン・ジョンギュ代表も来て同じことをおっしゃってましたよね。結局はソフトウェアのロジックが目的物であって、コードはそのロジックを実装するための中間ツールに過ぎず、それがなくなりつつあるじゃないですか。それから、Andrej Karpathyが以前ある講演に出て「9の行進」という言葉を使ってましたよね。“March of Nines”という表現を使っていたんですが、そうですね。最初の90%にかかる労力、そして90%を99%にする労力、そして99を99.9、99.99にする労力、それぞれ9を一つ追加するたびにかかる労力の大きさは同じだと。つまり、ClaudeのこのCコンパイラもまあ90%まではそのままやってくれるわけで、ちょっと大げさに見れば99%まではやってくれるけど、しかし99.99%の立場にいる巨匠の目から見ればその足りない0.99%、これがものすごく大きなギャップに感じられるだろうし、そのギャップを感じる部分がさっきスンジュンさんが最後にまとめてくれた非常に人間的な価値、センスだとか意志だとか、そういう部分にこそあると。だから私たちにはこれから やることがたくさんある、まあそういう話で締めくくってくれたと思います。

Andrej Karpathyの9の行進: 90%と99.99%のあいだ 8:35

チェ・スンジュン だから、いずれにせよ重要な意味を持っているけれどまだイノベーションにまでは至っていないというのがLattnerの話であり、それでもなお見る価値があるのはこの方向性が意味するもの、そしてこれがニューノーマルになったとき私たちに何ができるかを考えることが重要だという点を、もう一度強調しておきたいと思います。また「センス」という言葉が出ましたよね。それで私たちも「センス」の話を繰り返ししていますが、最近何度かお話ししたカン・ギュヨンさんが現在CorcaのCTOをされていて、「センスのあるソフトウェア」という記事を書いている最中のようなんですよ。この記事も面白いのでぜひご覧になってみてください。ところで、イノベーションが必要なのは実は科学や数学では

すべてを検索問題に: 科学と創薬 10:12

チェ・スンジュン 既知の問題を繰り返すのではなくイノベーションが必要じゃないですか。だから今そこでも何かが起きているんですよ。しょっちゅう話が出てきますけど私たちが全部追いきれてないですよね。

ロ・ジョンソク とはいえ、ものすごく要約すると、新薬開発というのも何か問題を引き起こすタンパク質を見つけて、そのタンパク質が何かを発現させる過程に関わるメカニズムがあるじゃないですか。それを阻害したり促進したりする形の何らかの物質、いわゆるantibodyと呼ばれるそういった物質を作ってそのプロセスを化学的に阻害するのがほとんどの薬のメカニズムである場合が多いんですよね。つまり、結局はタンパク質の構造を把握して、それに合う別の構造を見つけるゲームなんですよ。だから明確にこういった部分もすべてcomputationに置き換えて探索問題として解けるということを今示しているわけです。ところで、この内容以外で、私が翻訳してみながら

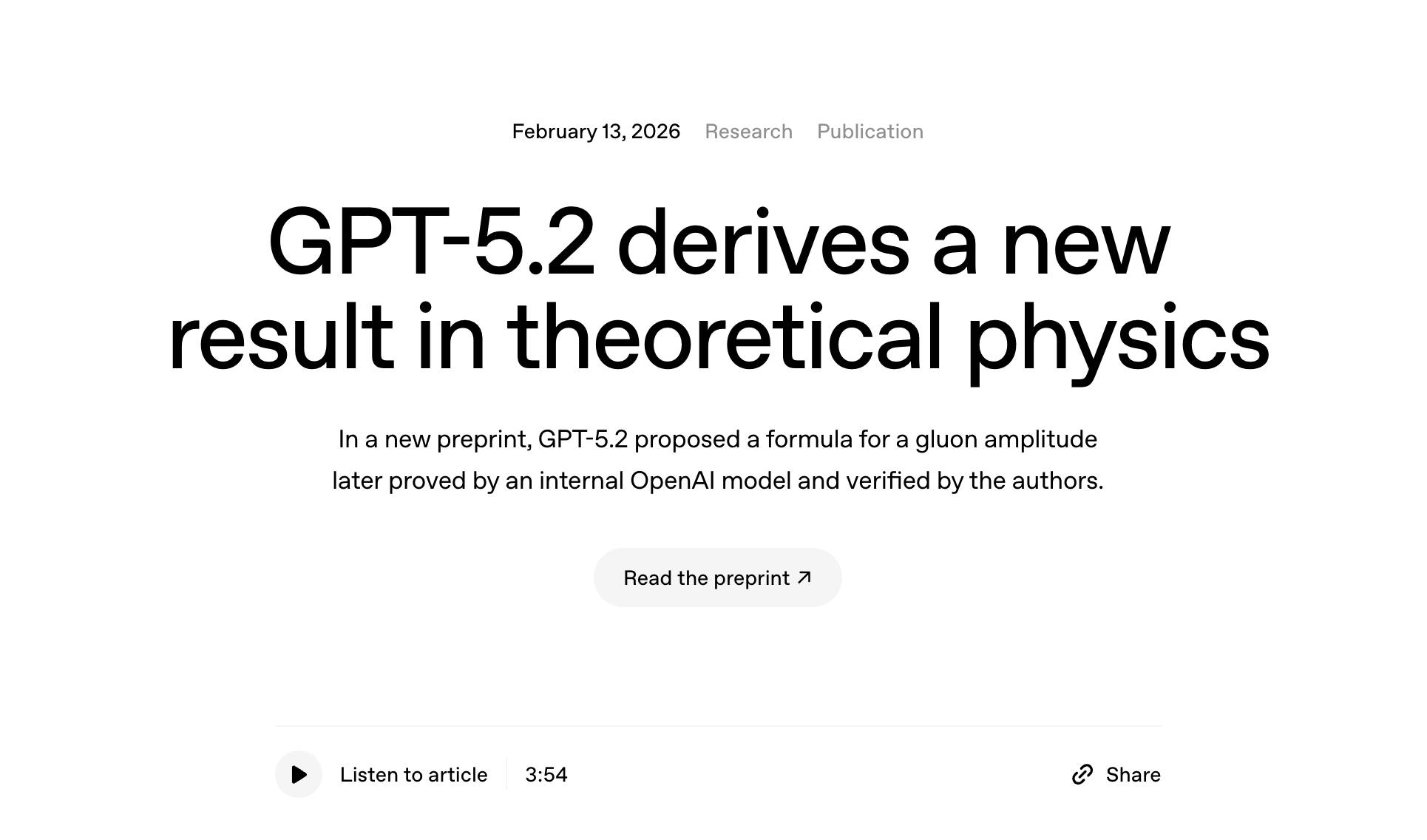

OpenAI理論物理の事例とケンタウロス時代 11:07

チェ・スンジュン じっくり読んだのはOpenAIの理論物理学におけるある論文が出た事例です。そのOpenAIと科学の回を私が去年末にちょっと強調していたんですが、Kevin Weilとそのブラックホールを研究する科学者の例を一度ご紹介しましたよね。その方が他の研究者たち、自分の師匠も含めて完全に理論物理学の最前線にいる方々をOpenAIに連れてきて、一緒に何かを議論しているうちに論文が一つ出た事例です。OpenAIに入ったブラックホールを研究している科学者の師匠なんですが、1年前にはAIがどれほど役に立つか分からないという考えだったのが、つまり2024年頃にはそう思っていたのが、あるいは2025年初めの時点でも、1年後にGPT-5.2 Proと何度かやり取りした末にOpenAI内部モデルに最終的な問い合わせを送り、そのモデルが量子場理論でこれまで解けなかった問題を解決しただけでなく証明までやってのけたと。12時間でという話が、そういう話がありました。それでモデルがその分野で世界で最も優秀な人たちのうち2人が成し遂げられなかったことを成し遂げたのだと。そして私が彼らと一緒にいた時、彼らは興奮していた。

まあそういう話です。

ロ・ジョンソク そうですよね。コーディングはすでにケンタウロスの先の時代に入り始めていますが、科学はケンタウロスの時代に突入した感じですね。Gary KasparovがDeep Blueに負けてからチェスの分野でケンタウロスの概念が生まれたんですよ。ケンタウロスは半人半馬じゃないですか。それでAIと人間がチームを組んでやればAI単独や人間単独よりもうまくいくというケンタウロス方式のチェスが流行した時期があるんです。科学はついにケンタウロスの時代、AIと共に取り組む時代に入り、一方でコーディングはAIにもっと委ねる方向に進んでいて今は科学と数学がそこを追いかけているという印象を受けています。これは本当にあらゆる問題が

search problemに変わりつつある気がします。ただ電力とより多くのcomputationを投入してまだ行ったことのない領域を今inferenceトークンがすべて探索しているわけじゃないですか。以前は人間が一つ一つ考えながらやっていたことを今はすべてcomputationに置き換えて起きていることだと思います。

チェ・スンジュン それでこの彼らの経験に関する話がTwitterでは賛否両論なんですよ。ただいずれにせよこのブログの周辺や本人当事者たちが語っている内容は、2026年にAIが物理学に対してすることは2025年にコーディングに対してしたことと似たものになるだろうと、そういう話をしていて、私がこれをSNSに翻訳した内容を投稿したら実際に韓国にいらっしゃる科学者の方々が何人か感想を残してくださったのも印象的でした。こういうことが起きているんだな、自分も備えなければ、大学院はどうなるんだろう、そういった悩みも、

モデル能力の本質は内挿か外挿か? 14:14

チェ・スンジュン そういう話が見られました。つまり私たちがまだ初期の頃にしていた話ですが、私たちがなぜこのモデルの発展を語りながら「モデルは単なる内挿エンジンだ」という話を初期の頃にたくさんしましたよね。interpolation程度のことしかできない、新しいものへは踏み出せないという話をモデルがまだ未熟だった時期に人間たちがたくさんしていたじゃないですか。ところが今出ている結果を見ると実はすべて逆の役割じゃないですか。すべてextrapolation、外挿しているように見えますが、私がこれについて持っている考えは、私たちのモデルが投影している全体の真理を100とすると、その100という部分がモデルの中で非常にsparseに実装されているわけですよね。ただのinterpolationだと私は思います。だからこの広い空間でそのsparseな点の間をinterpolationしているのが人間の立場からはextrapolationのように見えるのだと思いますし非常に広大な領域で補間が行われれば新しいもののように見える可能性は

実際に新しいものがそうやって生まれているとも言えますし。私たちが人間固有の創造と呼んでいるものも

ロ・ジョンソク 実はすでに存在していたけれど発見できていなかった空間を誰かがそれを見つけ出すに過ぎないのであって、全体の普遍的妥当性を100として見れば。だからこそこのモデルのcomputationがさらに増加しgeneralityがさらに増加すればその間にあったものもすべて可能になるということを、もちろん時間の問題はありますがすべて可能になるということを前提に何事も据えるべきではないかという気がします。モデルがすべてやり遂げる可能性がありますという話を

私たちはしているわけです。ただ先ほどの発表では革新的なものはなかったという印象でしかしそれをニューノーマルとして捉えた時にやるべきことは何かあの途方もないことをやってくれたのは確かだから、そういう話でしたね。私がこの物理学に関する話の中でずっと自分なりに鋭い目で見ているのは何度かやり取りした末に、そして内部モデルだと言いましたが別の記事ではこれが内部モデルではあるもののOpenAIがまだ公開していないスキャフォールディングまたはハーネスという表現もあるんですよ。普通のGPT-5.2 Proではできなかったことをその特殊なハーネスがある環境で12時間回して成し遂げたという話なんです。そういう話として私は理解しました。それも重要ですが、何度かやり取りしたということも重要に感じていて、なぜ彼らにはできたのか。当然最高の専門家であり最高水準の物理学者だからそれができたのでしょうが、結局はあるプロンプトに還元されたはずですよね。そのプロンプトに還元される前のものとは何だったのか。私がただ同じプロンプトを入力していたらおそらく理解はできないでしょうが同じ応答をしていたはずですよね。そのモデルとハーネスは。だから私はこれがずっと気になるポイントなんです。どんな語彙でどんな文章を書いたのか。スンジュンさんが1月初めにおっしゃっていた

あの良いプロンプト、プロンプトを上手く書くこと、それに関連する話ですね。実は一ステップ一ステップ進むたびにモデルの中のあるspaceが変わり続けているわけですよね。representationするspaceが完全に変わっているわけですからそうやってまた辿り着いていくのでしょうね。だからそのspaceを次々と遷移させていける能力、それがおそらく好みであり方向性を設定する人間のある種の価値であり、そういったものだと今の私たちがおぼろげに感じ取っているのではないですか。そうですね。ただ先週ジョンギュさんと話した時も

チェ・スンジュン ジョンギュさんがスペックを長く書いていた昨年半ばのスタイルから今はまたティキタカモードに戻っているのを少し垣間見せてくれましたよね。ただ私たちの前回のエピソードでの例は非常に簡単なものを使って説明しましたが、ジョンギュさんなりの語彙とジョンギュさんなりの知識が溶け込んだそういったトークンを確実に使っていたはずだということですよね。ああ、もちろんです。

エージェンティックコーディングの現実: Ralph loopの限界 18:19

ロ・ジョンソク だから最近私もagenticコーディングをガッツリやっている方々とたくさん交流しているので以前はoh-my-opencodeのようにただ無条件に目的に合わせて最後までやれと言いながらフックをかけ続けて永遠に回させるそれを通じては先ほどのCコンパイラの話のように私たちが知っていること以上は出てこないというに対する認識はだいぶ生まれたと思います。それで、その地平を広げるそういう作業に進むにはhuman-in-the-loopが必ず必要なんです。そのcontextを理解して別の方向へ継続的にsteeringするpromptを入れ続けなきゃいけないんですが、そのralph loopとは完全に相反するんですよ。それで最近、僕も作業していて感じるのが、本当に簡単な作業や

すごく明確で早く答えを出さなきゃいけないものはそのralph loopを回して力技で処理してしまうんですがそうじゃなくて何かロジックを作らなきゃいけなかったりうちの会社の事業にぴったり合う何かを作る領域になると一ステップずつ自分で見るようになるんですよ。せいぜいサブエージェントを3~4個回して答えを持ってこさせて、それを比較させて、その比較した過程をまた自分で見て。でもそうしていると終わった後に感じるのが、input tokenの量がものすごく多くてoutputが少ない、そういう作業になるんですよね。そうすると、これはまあいいんですけどいいものが出来たっていう成果が生まれてきてそうやって先ほど話した通り、9がひとつずつくっついていく感覚そういうものが得られるようになります。それでagentic codingのトレンドも今この先駆者たち、先に行ってすべてを経験されている方々を見ると、少し変わってきているんですよ。つい直前まではralph loopだったんですがralph loopではダメだという意見がいくつか出てきています。なので、こういう分野のフロンティアにいらっしゃる方々をもう一度お招きしてお話しするのがいいと思います。実はジョンギュさんも先週その話をされたんですよね。

チェ・スンジュン これも一種のgradientが生まれていて私たちが学び続けている過程なのでこれを少し外挿してみると次のトレンドがあるだろうなと予測できますよね。なぜならトレンドが変わっている最中だから。それで僕が注目した部分はティキタカモードを、非常に密度の高い語彙とdomain-specificなものが含まれたティキタカモードがあってそれがある程度ティキタカして何かが決まると良い質問が生まれたり、指示文が生まれたりしてすると長時間回すloopがそれを実行できる、その2つがある意味共存していて互いに相乗効果を生み出すそういう2つの流れがあるんじゃないかと思いました。

だからティキタカも重要だけどスキャフォールディングも重要だと、あるいはハーネス。それで先ほどの物理に関するブログ、あるいはGPT-5.2 Proは間もなくある美しく一般的な公式を提案したけれどそれを証明することはできなかった。ところが内部にスキャフォールディングが適用されたモデルが12時間以上連続で思考した末にその公式を証明したんです。証明までして論文化されるのはやはりスキャフォールディングと内部モデルの組み合わせだと思います。それでOpenAIがまた興味深いことに、誰が流行語を先取りするかという問題なんですがハーネスエンジニアリングという概念をOpenAIが最初に言い出したわけではないかもしれない。誰かが言ったものを取り入れた可能性もありますが2月11日にこういうポストをまた出しました。

Harness Engineering 21:41

ロ・ジョンソク 一般的に使われる言葉になりましたね、ハーネスという言葉は。

チェ・スンジュン そうですね。スキャフォールディングと言ったりもしますが、違いがあるかは違いはありますか?ほぼ同じですよね。僕は同じことを言っていると思います。

ロ・ジョンソク 最近のベンチマーク、Discover AIとかそういうチャンネルのベンチマークを見ると、Grokの場合はそもそも最高モデル、一番お金を払うともらえるモデルが特定の単一モデルではなくてGrok 4.2 Agent Swarmなんですよ。一種の、だからGrok 4.2 SwarmとGemini 3.1 Proを比較したりそういうベンチマークもやるんですよ。だから単一モデルを組み合わせて使うのはもうこれは一般的なトレンドでしょう。

チェ・スンジュン そうなんです。去年の半ばくらいまではYouTubeでハーネスそういう話をするとコメントに「ハーネスって何ですか?」みたいなコメントがついたことがあったんですけど今はもう一般化されたようです。シン・ジョンギュ代表も先週出演されて

ロ・ジョンソク このClaude Codeの本当の実力はClaude Opus 4.6ではなくClaude Codeのハーネスだと思うとおっしゃっていましたよね。Fowlerが

チェ・スンジュン エクストリームプログラミングやリファクタリングで有名な方なんですがその方がチーム組織を持っているようでその中から出た記事なんですけど実際に書いたのはMartin Fowler本人ではないんです。ただOpenAIのハーネスエンジニアリングに言及しながら僕がそれに共感する話をいくつか書いてあって、かなり最近のトピックを扱っている印象でした。Martin Fowlerと言えば少し保守的だと思っていたんですがそうではなく、最近の話題を取り上げているようです。こういうベテランの方々、僕らより上の世代の方々、Kent Beckもいますし、Kent Beckも最近LLMを積極的に活用されていて。アジャイルやXPの分野で活動されていた方々もこういったトレンドを、トレンドというよりはまあいずれにしても今の発展方向をしっかり学ばれていてまた独自の考えを発信されている昨今だと思うのでとりあえず僕ももう少し勉強してみようと持ってきたのがハーネスエンジニアリングという表現でした。

ロ・ジョンソク そうですよね。最近は本当に現役の年齢層がスペクトラムが広がったと思います。昔は30代40代がメインで50、60、70だと存在感がなかったのに最近は30からあの上の70代の方まで全員現役ですよね。

チェ・スンジュン そうですね。Kent Beckもコーディングが最近すごく楽しいって言ってますよ。

ロ・ジョンソク ええ、あの方がそうおっしゃるくらいですから。だからとにかく新しい地平が開けて

チェ・スンジュン 面白いのは間違いなくて、そういうことを可能にするハーネスエンジニアリングやスキャフォールディング、そういったものが非常に重要視されている25年に、Claude Codeがある意味きっかけを作ったんですよね。その後多くの派生が生まれて、最近はOpenClawも、結局ハーネスなわけじゃないですか。人間が何度かやり取りできる能力、意味を生み出せるものを作ることとスキャフォールディング、あるいはハーネス、そして新しいモデル、.1ずつ上がっている。増加傾向の。そしてMETRをsaturationさせてしまったそのモデルの能力、そういったものが3つの組み合わせ可能なそれぞれが一つの軸なんだなと考えるようになりまして。

FOMO産業とAIうつ 25:11

チェ・スンジュン しかし現実は、Matt Shumerが投稿した記事がものすごくバズって数百万人が見たんですよ。それから私もこれを翻訳したものをかなり共有しまして。300回以上シェアされたと思いますが、Facebookで「この巨大な何かが迫ってきている」というある意味では現実認識でもあるんですがちょっとFOMOを煽るような記事だったんですよね。大騒ぎと現状の重なり。そうですね、大騒ぎと見るべきでしょうか?

ロ・ジョンソク それとも現状と見るべきでしょうか?いや、私は重なっていると思っています。

チェ・スンジュン ですから私たちもそう見られることがあるかもしれませんがAIに関して話すことがFOMOを煽らないと食べていけない業界になりつつあるそんな感じで、今大変なことになっているからついてこないと、というトーンを暗に出さざるを得ないですよね。

ロ・ジョンソク でも今実際に価値を生み出していてお金を動かしている会社はモデルを作りコンピュータを作る会社以外の、既存の会社は今みんな憂鬱になっている状況でその間でFOMOを煽るYouTuberたちが登録者を増やしながら広告やスポンサーをたくさん受けている、そういうことですよね。

チェ・スンジュン とにかくそうなんですが、こういうストーリーは伝染性があると思います。まあ、みんな共感を呼ぶからですよね。これはみんなが感じていることで

ロ・ジョンソク 「じゃあ私はどうすればいいの」というその苛立ち、不安 — 不安という言葉が一番しっくりきますね。不安感を代弁しているからです。

チェ・スンジュン それで、これは最近、数日前だったと思いますが。Nütildの代表が「AIのワンクリック時代、なぜ私たちは憂鬱になったのか」というブログシリーズを始められたようなんですよ。それで私もタイムラインで見かけたんですが「AI鬱」という表現が面白くて持ってきました。ワンクリック時代の憂鬱が生まれているということで、私たちもジェフリー・ヒントンの憂鬱から始まったチャンネルではありますが。

ロ・ジョンソク ジェフリー・ヒントンが「もうやめろ、このままだとみんな死ぬぞ」と言っていたのが3年前ですね。

チェ・スンジュン でもなぜワンクリックと憂鬱は一緒についてくるんでしょうか?そのワンクリックが自分じゃないからですよ。

ロ・ジョンソク ワンクリックする側の人たちは今楽しんでいますよ。

チェ・スンジュン でもワンクリックしている人も憂鬱になりうるんじゃないですか?

ロ・ジョンソク ええ、それは目的関数が何かによると思います。つまり、うまくいっている時は楽しいんですけど、先週ジョンギュさんに

チェ・スンジュン スタートアップのリスクは何かという話をした時にあの簡単に複製できるワンクリックの話もされていましたよね。ワンクリックのせいでBackend.AI GOのようなものがワンクリックで片付けることはできないし、そこに多くのものが込められて溶け込んでいるのは確かですが、はるかに短い時間でそれが実現したのは事実ですよね。

ロ・ジョンソク だから複雑になって、結局クーパンで商品が大量にあるのと変わらないんですよ。良質なソフトウェアが非常に安い価格で大量に出てくる世の中になるわけで、でも私はそれについてあまり大騒ぎすべきではないと思っていて、「わあ、もう誰でもソフトウェアが作れる時代だ」「だからB2B SaaSはなくなる」とか。最近のインタビューでもそういうワーディングが出ましたけど実際にはソフトウェアがなくなることが問題じゃないんです。良いソフトウェアがもっと増えるわけで、良いソフトウェアが増えれば人々はその中からgreatなものを探してそこに集まります。だから相対的に背景が変わっても良いものを見極める目は絶えず厳しく存在するので私は物を売る商売をしてみて分かりましたが顧客は不思議なほど全部分かるんですよ。良いものと悪いもの、これにお金の価値があるかないか、そういうことを分かっているのですべては相対的なものなんです。だから次に進んで、変化していくものに対して間違っているとは言うべきではないと思います。ついていくことだけが最善です。

カチッの世界で良いソフトウェアは増え続ける 28:05

チェ・スンジュン でも大変ではありますよね。

ロ・ジョンソク だからビジネス界でいつも通じる格言があるんですよ。お客様はいつも正しい。「Customer is always right」という表現がありますが顧客がお金を払う方向を目的関数に設定すればただそれについていけばいいんです。

チェ・スンジュン それで私はとにかく冒頭でも申し上げましたが1月、2月とニュースは見ていますが練習をそんなにいつもしているわけではなく最近のトレンドに関する練習をあまりしていないんですよね。だからストレスも少し減って、でも適度な挑戦があって、健全に追求できる何かに集中してみている最近だと思います。それで自分を楽しくさせる方向性として何か遊びみたいなものって何かなと思った時に、またAndrej Karpathyがどーんと何かを出しましたよね?

Andrej Karpathyのmicrogptで楽しさを見つける 29:48

ロ・ジョンソク microgpt。

チェ・スンジュン microgptをまた面白く探索する時間を持ちました。それでこれをざっと見ていくとブログでもAndrej Karpathyが投稿していて、頭にmicroが付いているのは2020年にmicrogradというものを発表していたんですよ。microgradを発表していて、そこにValueというクラスがあったんですが、それが自動微分をスカラーベースで行う非常にシンプルな実装だったんですよ。数十行程度の実装で、それを活用して200行でぴったり収めたんです。そして3カラムで構成されるGPTのコードを公開しました。かなり面白いんですよ。

ロ・ジョンソク つまりTransformerを実装したということですよね。そうです、非常にシンプルな。それで名前を生成するものなんですよ。GPTの部分は

チェ・スンジュン ちょうどこのくらい、1ページに収まる程度でさっきスカラーという表現を使ったのは

ロ・ジョンソク 本当に完全に私たちが慣れ親しんだforループで愚直に実装しているんですね。必要なものだけが正確に全部入っていますね。一行多くも少なくもなく

チェ・スンジュン コード全体を見ると matmul とかも全部 Python で実装してあるんですよ。200行以内でそれができるコードです。僕はこれを一通り写経してみたんです。面白半分でずっと追いかけてやってみてColab で実行してみたりしたんですが、面白かったですね。アルファベットがそれですね。トークンがただアルファベットを使ってるんですね。

ロ・ジョンソク 昔 Andrej Karpathy が急に人気を集めたのが2015年くらいで、character RNN。まさにそんな感じですね。

チェ・スンジュン それで僕がやったんじゃなくて Claude にやらせたんですが僕がちょっと実験してみたかったのは実は自動微分でできることがTransformer みたいなものだけじゃないんですよ。だから僕は以前からこういうものを色々探ってきたので例えば画像の分野で DALL-E が出た2021年に CLIP も出たんですよ。CLIP が出て OpenAI が CLIP を発表してからはCLIP で何らかの loss を作って画像をシンプルなネットワークで最適化して画像を生成する作業がたくさんあったんです。それでそういうことをしながら自動微分などの力というものを実感できたんですが、僕が持っていた背景知識の中で他に何を試したかというとAndrej Karpathy が作ったその実装を使って

自動微分の創造的応用と学ぶ喜び 31:34

チェ・スンジュン 応用してやったんです。あるものとあるものは一定距離内に収まらなきゃいけなくてこれは垂直でなきゃいけなくて、あるものは重なってあるものは重ならないようになっている — まあここは重なってますね。そういうある種の規約を表すものでこういう規約を微分可能な関数に変換してやると自動微分はこういうことができるんです。レイアウト最適化みたいなことができるしそういったものが動くかどうかをAndrej Karpathy が作った Value クラスをポーティングしてちょっと実験してみたんです。

ロ・ジョンソク 実は大きな枠組みではディープラーニングと何も変わらないですよね。

チェ・スンジュン ディープラーニングなんですよ。モデルがとてもシンプルなだけで

ロ・ジョンソク 目的関数がクロスエントロピーではなく別のものを使っていてしかしそれを学習するのに使うアルゴリズムは同じでつまり僕たちが視聴者の皆さんにお伝えすべきインサイトはとにかくさっき申し上げた超弦理論の物理学の最前線で答えを見つけ出すことと、今スンジュンさんが見せてくれているそこに入っていくものとアルゴリズムは同じだと。投入される計算量が違うだけだと。

チェ・スンジュン 僕がこの文脈で話したかったのはドメイン知識を僕が注入したときさっきの Penrose だとか自動微分での応用事例みたいなものを僕が知っていたものがあったからinverse kinematics を使うとかそういうものを注入しなかったときでもモデルがそういうものを提示してくれたのかが気になるポイントでした。こういうものもそういう基盤でできることなんですがこうやってただクリエイティブコーディングのネタを発想してみようと始めた会話がありました。ここでは僕が知っていた情報は使いませんでした。Python じゃなくて他の言語にポーティングして応用してもいいと。リアルタイムでインタラクションできる方向で何かできるか探ってみようということを ChatGPT でもやったしその次に Claude でもやりました。二つが似ていながらも違うものを紹介してくれたんですよ。それでここでリアルタイムの絵が

学習するキャンバス、微分可能なパーティクルシステム微分可能な synthesis — つまりオーディオの方ですね。それから computation graph、その他もろもろL-system、こういったものができるかをやらせてみたんです。こうすると decision boundary をきれいに描いてくれたある領域、decision boundary をやるんですがそれをきれいに描いてくれるものがパッと一つ出てきてその次にこれは自動微分の過程をcomputation graph を可視化するものをきれいに作ってくれるようにチェーンがどうなってるかとか、そういうのを作ったしそれからちょっと挑戦的なのは L-system といって木みたいなものを描くアルゴリズムでフラクタルっぽくもありますよね。ここに僕がポイントを描いてあげるとそこに最適化されてそういうことをちょっとやってみたんですがこれは知っていたことではあったんですよ。こういうことができるということを昔だったらああいうの一つ一つが

ロ・ジョンソク かなり時間をかけなきゃいけない作品だったのに、本当に最近はもうパッとできますよね。できることをできるようにするのは簡単なことじゃないですか。

チェ・スンジュン できると分かっていることをできるようにする、だから新しいことはなかったけどできることをできるようにするのはうまくいくと確認しました。でもこの ChatGPT との会話は実装したことよりも内容を一緒にやり取りしたのが面白かったんです。ここでもこういうことをするときどうやってそのエネルギー関数を作るべきか、つまり微分可能でなければできないことだからある言語で表現されたり、自分が作りたいものを微分可能な形に変換する作業が必要なのが重要なんです。それを最近は AI に頼んでやればいいんだと気づきました。自分がやりたいことがあるんだけど、それを微分可能な関数をどうデザインすればいいかを聞けばいいんだなと昨日感じました。つまり昔僕が苦労してやっていた作業を全部再訪して、やることがたくさんあるんだなと感じました。だからこれでまたちょっと楽しさを取り戻した、そんな感じです。実はこういう面白いことがもうたくさんあるんですよ。

僕がさらっと流しましたが ChatGPT と会話したのが僕が知っていることも話しましたが知らなかったことを教えてくれたものもあったんですよ。僕のさっきの質問がこれだったじゃないですか。ドメイン specific な用語、Penrose、Bloom こういうものを入れたとき応答するものと、それを入れずに応答したものにも僕にインサイトを与えてくれる何かがあったのかということだったんです。どちらもあると思います。入れないバージョンでも学んだことがあったし入れたバージョンでも学んだことがあったしそしてコードを覗いてみて学んだことがあったんですよ。だから僕が最近ちょっとトレンドに

結果より過程: 学び直す楽しさと好み 37:11

チェ・スンジュン ストレスを感じていたのかなと思ったとき、その生成物を見て結果じゃなくてその過程で得る楽しさを少し見失っていたようでストレスを感じてきたんです。実はコードを覗いて理解して学ぶことが好きな性格だったのに今はかなり回り道をして、ここに辿り着いたんですけど、この方向に進んでいく中で1、2年ほど僕はコーディングをあまりやらずに、指示するだけでしたよね。そうしているうちにストレスを受けたんじゃないかと推測しています。でもこうやってまた勉強して、自分の手でタイピングしてコーディングして、さっきのmicrogptを一通りやってみて、一部は暗記しようともしてみて、応用もしてみて、あれこれやってみたら、また楽しくなったんですよ。僕もその部分は同意します。僕もただループを回して、わあ、

ロ・ジョンソク トークンをどれだけ使ったかなという段階を超えて、改めて自分で目的を明確に設定して、モデルとやり取りしながら自分が学んでいくことがどんどん増えていくのが、僕は楽しいんですよ。

チェ・スンジュン つまり、これって成果の生産性においても確かに重要な部分があるんですけど、人間である以上、学ぶことの楽しさも無視できないんですよね。もちろん生産性を上げるにはハーネスを開発しないといけないので、その開発する楽しさはあり得ますよね。

ロ・ジョンソク だからここで、僕たちが初期にしていたような話に結構戻るんですよ。僕は依然として、モデルがハーネスであろうが何であろうが、単一モデルであろうが集合体であろうが、それは関係なく引き出せるアウトプットの品質は、その人間の限界を超えることはできない。でもそれが実はまた悩みでもあって、

チェ・スンジュン 僕が締めくくりたいのは、これも大事ではあるんですけど、一番最初に戻ったとき、これができたらいいなとは思うんですよ。知らないままでも正しい方向に進むにはどうすればいいか、まだ僕も答えは得られていないんですけど。でも僕はそれについて、

ロ・ジョンソク 不十分ながらも結論が見えるところがあって。知らないままでも正しい方向に進むには、その進んでみる方向の中で自分が学びを得て、判断の質を高めていくそのプロセスと結びつければいいんです。そうすれば、知らないまま始めたとしても、学んでいく中で、自分が何を目指したいのかさえもその過程で気づくことができるんですよ。「始めることが半分だ」という昔の人の言葉は正しい。だから知らないままで、自分がどこに辿り着くか当然わかるわけがないじゃないですか。矛盾ですよね。だから知らないままでも答えを得られるということ自体、僕はその言葉自体が成立しないと思うんです。しかし、知らないまま始めて、何かを知った自分が何を求めていたのか気づくという結果に辿り着ける。そのプロセスがモデルによって非常に加速されるわけで、うちの子がまだやっと20歳の大学生なので、あの子はどう生きていけばいいんだろうと悩みながら感じるのが、最近こういう話をよくするようになるんですよ。「お前はまず知らないといけない」と。だから僕もとにかく探索中ではあるんですけど、

チェ・スンジュン 僕がMVKの候補として置いているのは、仮説を立てて実験する姿勢のようなものなんですよ。

ロ・ジョンソク でもそれ、スンジュンさん、それはスンジュンさんが高等教育に加えて物理・化学・生物に関する幅広い読書、それから数多くのコーディングの失敗、そういったものが全部合わさっているからこそその上で今MVKをおっしゃっているわけじゃないですか。いや、でも僕がその子供の、

チェ・スンジュン 生後10か月の赤ちゃんの写真を何度もお見せしましたよね。その音を聞いて、雑誌に耳を傾けてみるというあの姿勢は実は10か月の乳児でもできることなので、仮説を立てて実験するのは人間の本能的なものだと思う方ではあるんですけど。もちろん僕がこれを発表したとき、多くの方のフィードバックがそれなんですよ。そこまでフラットにはなれない、と。でもそれがずっと悩みのポイントなんですよ。知っている人の方がうまくできるというのは常にそうだったわけで、AI時代には少し変わるべきじゃないのかという悩みがあるので話しているんですけど、僕がこういう話をしたときにいつも受けるフィードバックは、それはそう簡単なことではない、そしてうまくいかないだろうという話をよく聞きますね。

ロ・ジョンソク おかしな話ですが、AIも聞かない人には答えをくれないんですよ。

チェ・スンジュン 質問にたどり着くまでにも実はハードルがありますしね。でもそのハードルを越えた瞬間、それを越え続けると決めた瞬間は、

ロ・ジョンソク スンジュンさんが今おっしゃったそれが姿勢じゃないですか。生まれるんですよ。学んだことをモデルにどんどん教えていくわけですから。

チェ・スンジュン だから何か、今僕たちがずっと立ち戻っているキーワードが姿勢だったり、さっきの好み、こういうもの、あるいは時には意志、言葉は違うけれど共通する何かがあるなとは感じますね。それに、学ぶことは山ほどありますよ。

ロ・ジョンソク いやほんとに、僕も最近会社で腰を据えて座って、様々なロジックをCodexと一緒に書いているんですけど、そこで学ぶことが、うわ、自分はこれ全部知らなかったんだなと。こうすればいいんだ、ああすればいいんだと。会計もわかるようになるし、マーケティングもさらにわかるようになるし、Meta広告はこうやって回っているんだなと、なんとなくやっていたことを細かく理解できるようになって、その場でデータのバックテストも全部やってくれるし、この仮説は合ってる、間違ってると全部教えてくれるから、うわ、これってまさにアイアンマンのJARVISと一緒に仕事してたのと同じじゃないかと。でもそれができるようになったから、

健やかに使う: AIが酷使させるメカニズム 42:33

チェ・スンジュン 今僕はどんな時代を生きていると思っているかというと、これが過渡期かもしれないしそうじゃないかもしれないけど、あまりにもできてしまうから、健全にやる方法を今人々はまだ知らない状態で、それが危険なんだということをわかり始めている最中だと思うんですよ。AIが自分を酷使させて、無理をしてしまうメカニズムなんだなと。なぜならできてしまうから。できないけどできそうなそんなヒントが次々と出てくるから、無理をしてしまって、それが健康も損ない、FOMOも引き起こし、そういった問題なんだと気づいていくことが2026年のトレンドになると思います。それでも楽しいですよ。

ロ・ジョンソク 朝起きたら今日は何をしてみようかなというワクワク感が生まれるから、楽しい時期なんだから楽しくいきましょう。

チェ・スンジュン 僕がここでこのスライドをお見せしたとき、これを説明しましたけど、このプロンプトを、もちろん前にもっとあるんですけど、このプロンプトを書くとき24回書き直したもので、だからこの前にプロンプトがもう少し長くあるんですけど、望んだ応答が出るまでこうやって24回繰り返して直すんです。語彙を一つ変えてみたり、文章を変えてみたりしながら、「削る」という表現を最近よく使いますよね。プロンプトを削る過程だったわけです。こうしながらイライラが楽しさに変わる方向を少し探ってはみたんですが、

やはりイライラする部分がまた別にあるんです。別の話なんですが、僕は今年の新年にGilbert Strangの線形代数の本をもう一度読むと言ってたじゃないですか。年初にGilbert Strangの線形代数の本を読むことにして読み進めたんですが、まだ1章を読み終えて、2章には進めていません。なぜかというと、まだ分からない部分があって、同じ質問のバリエーションをもう何十回も聞いているんですよ。でもこっちは、たくさんやれば結果をもとに自分の望む結果に調整していけるんです。ところが同じことを何十回やってもあるものはやっぱり分からないんですよね。それで手書きもしてみたり、AIを使ってインタラクティブなチュートリアルを作ってみたり、それでもまだ分からない中でより細かく分からなくなる部分があるんです。自分が何を分かっていないかが分かるようになる感覚、それを絞り込み続けている感じはあるんですが、同時に湧いてくる疑問が、これを結局自分は理解すべきなのか、それとも——でもやっぱり諦めにくいのが、自分が完全にそれをpre-trainingして消化、grokkingできたと思えたならその次にさらに積み重ねられそうだという感覚はあるんです。だから勉強するのが楽しくもあって、やっていると進度は出なくてもこれが分かるまでもう少しやってみようという今の姿勢ではあるんですが。まあ正解はないんでしょうけど、これを棚上げして使えればいいやと割り切って進むか、本当に分かるまでやるか、そんな最近です。みんな今、旅人になったような気がします。家で気楽にいたかったのに、

Gilbert Strang線形代数と最後まで掘る学習 43:54

ロ・ジョンソク 否応なく未知の空間に放り出されて。

チェ・スンジュン 押し出されましたよね。

押し出されましたよね。あれこれ探しながら、その中で誰かは不安を感じ、誰かは楽しさを感じ、誰かはこの環境が最高で、誰かは嫌でたまらない。それでも私たちがこうして生きている以上、この大変革を目の前で目撃しているということも実に楽しいことだと思います。それも無視できない楽しさでありモチベーションでもありますが、

この世界をうまく生きていくには、どこかに心の錨を下ろさないといけない気がします。重心が揺れすぎるので。ある程度は揺れるべきで、そうしてこそ新しい探索ができるけど、でもその錨を下ろしすぎたら変われないじゃないですか。だからこのバランス感覚を持つのは簡単じゃないんですよね。ロさんはうまくバランスを取れていますか?いいえ。答えは僕にも分かりません。

ロ・ジョンソク 常に背景の速度に合わせて走っていると、その背景の中で変わっていくものが見えてくるんですよ。さもなければただ通り過ぎてしまいますが、一緒に走っていると見えてくるものと、その中での機会。僕はビジネスをやっている人間なので常にこれをビジネス目的に置き換えて見ていて、その中でのビジネスチャンスをどうするかという方向で思考実験をよくやっているんですが、それをやっていると面白い人たちにも出会えますし、あの人はこういう挑戦をしているんだな、あの人はああいう挑戦をしているんだなと見ていて確実に感じていることはあります。大抵の人は答えだけ欲しがるじゃないですか。でもこのAIという空間は答えを一文もらってそのまま進むには複雑に絡み合っているものが非常に多い。

99 vs 99.99の差 46:23

ロ・ジョンソク それにレイヤーも、今やモデルが一つのライブラリのようにパッケージ化されて中に、下に沈んでいって、私たちはコールすれば答えを返すオブジェクトになってしまいましたが、そこでも何かビジネスを立ち上げるならモデルの中を見ずにはこの産業がどう進むかを知ることができないんですよ。その部分がまた違うところです。以前はPythonさえ分かれば、その下のCやアセンブリは知らなくてもいいと言われていましたが、これはハードウェアのコンピュテーションレイヤーからモデル、そしてビジネスまで、異なる階層を行き来しないと答えが見えてこない感じなんですよ。

先週ジョンギュさんがその話をされていました。モデルを削る仕事をまた始めたとおっしゃっていたんですよ。そしてすべてのソフトウェアがある単位業務として一つのモデルの中に全部入って、そのモデルの上に薄いハーネスが載るそういう構造になるだろうという話をされていたんです。じゃあ今は私たちがフロンティアモデルに全部載せてその上で全てAPIコールをしていますが、ジョンギュさんがそこで行き着いた結論は、それでもなおあらゆる小さなディテールにも再びモデルの世界が来るという話をされていたと僕は思うんですよ。

じゃあそうなった時に、その小さなモデルが新しいウェブサービスになるわけですが、そうするにはただB2B SaaSを持ってきて知っている本を一冊投げ込んでファインチューニングするだけで済むのか、それともその中で最前線をより活用できる人たちが優位に立つのか。全てが99と99.9、99.99の間で競争しなければならないなら、顧客はまた99ではなく99.99に集中するわけですよ。だからこれは何か私たちがこれまで持っていたスピードに対する感覚、価値に対する感覚が変わるということであって、再びその空間に入ってしまえばその中での相対的な差はまたそれが新しいノルムとなって広がっていきます。それが私たちの世代に起きているのが不幸ですが、裏を返せばスタートアップにとっても、あるいは変化を切実に求める個人にとっても、これは全てチャンスです。誰かにとっての危機は全て私たちにとってのチャンスです。そう置き換えて考えなければなりません。ところが話を聞いていると、

チェ・スンジュン ほぼ確信に近いものがあるんですが、ロさんはこれが楽しいに違いない。ビジネスがそうだからこそ僕も僕なりの楽しさを追求したいという楽しさがあるんですよ。そこからヒントを得るように、ビジネスに関することを考えたり、そういうことが楽しいんですよね。

ロ・ジョンソク だからこの歳になってもこれをやってるんでしょうね。

チェ・スンジュン とにかくそれを健全に追求できる何かについての話を今日はちょっとしてみたかったんだと思います。話してるとすぐ脱線しがちですけど、

ロ・ジョンソク 僕たちは純粋に勉強目的でこれをやってるじゃないですか。この目的意識が、これをどうにかして再生回数を上げて早く登録者を増やして広告をつけなきゃという目的だったらこんなこと全然やらないと思いますけどね。

登録者2万人、ありがとうございます 50:08

チェ・スンジュン でも登録者が増えると励みになりますよね。今、登録者はどのくらいですか?

ロ・ジョンソク 2万人。朝起きたら2万人になってましたね。驚きです。

チェ・スンジュン お祝いすべきことではありますが、とにかくこうして最後まで視聴してくださる方がかなり多いと、約30%くらいいらっしゃるという話を前にちらっとおっしゃってた気がしますが。うちの番組は1時間半もあるのに、

ロ・ジョンソク 最後まで視聴完了される割合が37%くらいなんですよ。すごいことですよね。感謝するばかりですし、コメントにご意見を残してくださること、同意するご意見にはあまり返信しないんですが、同意しないご意見には少しずつ返信するようになりますね。

チェ・スンジュン 今回の回には反対意見のコメントがつくかもしれませんね。

ロ・ジョンソク そうですね。それなら健全な議論につなげていきましょう。

チェ・スンジュン というわけで今日も楽しかったです。いつも土曜の午前にスンジュンさんとこういう話をすると、

ロ・ジョンソク 土日に考えるネタができるので、いつもいいなと思ってます。

チェ・スンジュン それではまた次回、元気な姿でお会いしましょう。

ロ・ジョンソク また来週お会いしましょう。

チェ・スンジュン 皆さん、ありがとうございました。